*Cette étude a été traduite en anglais.

La numérisation de l’information et l’arrivée d’Internet représentent des innovations majeures qui ont transformé l’industrie des télécommunications, les façons de faire dans l’économie et la vie des citoyens. De plus, l’ouverture de la concurrence dans les télécommunications est venue amplifier et complexifier les effets de l’innovation sur cette industrie. On a assisté à une véritable vague schumpétérienne d’innovation comme on en voit à quelques reprises seulement en un siècle.

La révolution Internet a donné naissance à tout un mouvement d’optimisme sans borne. Les acteurs financiers ont alimenté des prévisions économiques insoutenables, contribuant ainsi à gonfler une bulle spéculative dont l’un des effets s’est traduit par un surinvestissement dans les télécommunications. Ces excès ont soulevé plusieurs questions. Aurait-on pu au moins en partie éviter ce résultat grâce à une meilleure gestion des politiques macro-économiques ? La régulation du secteur financier, les règles de gouvernance des entreprises et les lois sur les faillites ont aussi été mises en cause. Le débat sur ces questions se poursuit. Dans cette étude, nous tentons surtout d’établir si une régulation de la téléphonie mieux adaptée aux nouvelles conditions à la fois technologiques et concurrentielles aurait pu limiter l’ampleur des excès de cette industrie.

La période d’expansion accélérée des télécommunications a été marquée par l’arrivée de nouvelles entreprises qui ont déployé des réseaux de transport utilisant d’emblée la technologie Internet. Cette poussée technologique, conjuguée avec l’excédent de capacité créée par le surinvestissement, a contribué à faire baisser de façon appréciable les prix de l’interurbain et des services Internet. La période a été marquée par de nombreuses transactions financières. Les anciennes compagnies se sont regroupées dans le but de mieux faire face à la concurrence, d’acheter de nouvelles entreprises pour accéder plus rapidement à la nouvelle technologie et d’offrir à leurs clients un guichet unique pour tous les services de communications. Les nouveaux venus ont aussi fait des acquisitions, notamment en se portant acquéreurs d’ex-titulaires de monopole, pour accroître le trafic sur leur réseau. Certaines sociétés ont adopté la stratégie de la convergence en tentant de marier contenu, transport et transactions en ligne.

Ces transactions ont conduit les entreprises à s’endetter et n’ont pas eu les effets espérés de synergie, alors que la baisse des prix a influencé les revenus. Ainsi, les difficultés du secteur des télécommunications ne sont pas uniquement reliées à l’optimisme excessif des intervenants mais aussi à de mauvais choix de modèles d’affaires. La fin du boom des télécommunications a amené plusieurs entreprises à déclarer faillite. D’autres ont lutté pour leur survie, notamment en démantelant par ventes d’actifs les conglomérats fondés sur la convergence ou le guichet unique. L’éclatement de la bulle s’est traduit par une évaporation de richesse financière énorme, des mises à pied importantes, l’abandon de plusieurs projets d’investissements.

Cette vague a eu par ailleurs des effets très positifs sur l’organisation de la société ainsi que sur la productivité des entreprises et la rémunération des employés, alors qu’Internet est rapidement devenu un moyen de communiquer et d’échanger des biens et services dans l’économie. Les utilisateurs des télécommunications ont profité d’une baisse appréciable des prix des communications et d’une multiplication des services offerts.

Aurait-on pu éviter ce gaspillage de ressources dans l’industrie de télécommunications ? À notre avis, précisément à cause de l’économique des réseaux, les organismes de régulation, grâce à l’émission de licences d’exploitation, auraient pu appliquer le principe bien connu dans ce milieu du partage de la capacité des réseaux, dans le but d’éviter tous ces dédoublements auxquels on a assisté. Mais, les milieux financiers se seraient opposés à une telle discipline en arguant que le libre marché est préférable pour faire l’allocation des ressources.

Pour mieux se préparer à l’avenir, des sociétés de téléphonie se recentrent actuellement sur leur mission traditionnelle et deviennent dans un monde compétitif des transporteurs très efficaces. D’autres viseront à occuper un créneau spécialisé sur le marché des services aux entreprises. Enfin, l’autre avenue serait celle du courtier offrant, en partenariat avec d’autres sociétés, un assemblage de solutions à ses clients.

Au Canada, l’ouverture de la concurrence et l’économique des réseaux n’ont pas produit des résultats optimaux, c’est-à-dire où, idéalement, l’intérêt des clients et celui des actionnaires des sociétés de téléphonie convergent. Il reste à voir si la concurrence sur un marché de l’interurbain de la taille de celui du Canada rend possible la présence d’un certain nombre de concurrents rentables à moyen terme. Sur la boucle locale, l’ouverture de la concurrence s’est révélée fort complexe et n’a pas produit les résultats escomptés. À notre avis, la vraie concurrence sur ce marché sera à caractère technologique. Le sans-fil et la câblodistribution peuvent, avec les progrès technologiques, livrer une véritable concurrence aux réseaux filaires des ex-titulaires de monopole.

Enfin, en faisant disparaître la notion d’interurbain, les nouveaux modèles d’affaires fondés sur la téléphonie IP vont poser un défi à la fois aux ex-titulaires de monopole et aux régulateurs si l’on veut réussir à établir des règles permettant d’encadrer ces avancées technologiques.

Innovation et spéculation

On a vécu, au cours de la dernière décennie, une expérience socio-économique exceptionnelle. La numérisation de l’information, la révolution de la bande passante liée au transport de l’information sur fibre optique et l’arrivée d’Internet représentent des innovations majeures qui ont transformé l’industrie des télécommunications, les façons de faire dans l’économie et la vie des citoyens. De plus, l’ouverture de la concurrence1 dans les télécommunications en Amérique et en Europe est venue amplifier et complexifier les effets de l’innovation sur cette industrie. On a assisté à une véritable vague schumpétérienne d’innovation comme on en voit à quelques reprises seulement en un siècle.

La théorie de Schumpeter2 soutient que les grandes vagues d’innovation ont des effets à la fois créateurs et destructeurs de richesse. L’effet net à terme est positif, puisque l’innovation demeure le fondement des grands changements sociaux et des gains de productivité qui améliorent le niveau de vie des personnes dans une économie. Mais ces gains se font à travers des bouleversements importants, tant économiques que sociaux, qui peuvent durer des décennies. De nouvelles entreprises, ou celles qui existent déjà, profitent de la vague d’innovation et adoptent les nouvelles technologies, alors que d’autres disparaissent parce qu’elles sont devenues obsolètes et n’ont pas réussi à s’adapter aux nouvelles conditions de marché. Ces ajustements du marché font également disparaître certains métiers, et des travailleurs peuvent ainsi se retrouver sans emploi. Rappelons qu’après une innovation majeure comme l’électricité, il a fallu des décennies avant que les entreprises s’adaptent aux possibilités offertes par cette technologie, et que les citoyens en bénéficient à leur tour.

Par ailleurs, en période de forte croissance économique, il est difficile pour les banques centrales, selon l’économiste autrichien et prix Nobel F. Hayek, de déterminer le coût du capital (le taux d’intérêt « naturel ») qui va permettre une allocation efficace des ressources dans l’économie. Si le coût est trop faible, on risque de se retrouver dans une situation de demande excessive d’investissement. Des prévisions irréalistes de profits futurs associés aux nouvelles technologies issues de la vague d’innovation peuvent alimenter, si elles sont conjuguées avec des taux d’intérêt trop bas, même s’il n’y a pas d’inflation, un mouvement financier qui peut propulser les valeurs boursières à des niveaux insoutenables3. La haute valeur des actions des entreprises incite alors celles-ci à s’endetter et à accentuer ainsi l’effervescence des marchés financiers.

C’est dans une certaine mesure ce qui s’est passé en 1890 au moment où l’électricité a fait son apparition. Les entreprises qui avaient adopté cette nouvelle technologie ont vu la valeur de leurs actions s’apprécier de façon considérable. Puis, lorsqu’il est devenu évident que c’était à long terme que les profits se manifesteraient, une sévère correction boursière a suivi4. Ce scénario s’est en quelque sorte répété de 1995 à 2001 dans le secteur des télécommunications, en dépit de toutes les connaissances acquises depuis un siècle sur le fonctionnement des marchés, les mesures de contrôle et les règles destinées à assurer le bon fonctionnement des marchés financiers, et malgré la grande diffusion de l’information comparativement à ce qui se faisait au siècle précédent. Innovation et abondance des fonds prêtables peuvent conduire à de coûteux excès pour l’économie.

Innovation et ouverture de la concurrence dans les télécommunications

La révolution de la bande passante et d’Internet a donné naissance à tout un mouvement d’optimisme sans borne alimenté par des gourous, des consultants en gestion et des analystes financiers. On a cru que la demande de bande passante augmenterait de façon presque illimitée, reflétant ainsi les nouvelles façons de faire dans l’économie et une transformation rapide de la société. Les acteurs financiers ont alimenté ces prévisions insoutenables et ont ainsi contribué à gonfler une bulle spéculative dont l’un des effets s’est traduit par un surinvestissement dans les télécommunications, ce qui a été à l’origine d’une crise majeure dans ce secteur dans le monde occidental.

Les lendemains de la bulle spéculative et les politiques économiques

L’industrie des télécommunications traverse présentement un douloureux processus de restructuration et de consolidation. Aux États-Unis, pas moins de 50 sociétés de télécommunications se retrouvent sous la protection de la loi sur les faillites. Des sociétés fusionnées sont en voie de procéder, ou l’ont déjà fait, à un démantèlement d’actifs. Il faudra encore un bon moment avant d’éliminer les excès d’offre et de retrouver une industrie performante.

Aurait-on pu au moins en partie éviter ce résultat grâce à une meilleure gestion des politiques macroéconomiques de façon générale, à une régulation plus sévère du secteur financier et à des règles de gouvernance plus strictes pour les entreprises ayant des actionnaires et traitant avec les marchés financiers ? De plus, est-ce qu’une régulation de la téléphonie mieux adaptée aux nouvelles conditions à la fois technologiques et concurrentielles dans lesquelles l’industrie fonctionne aurait pu limiter l’ampleur des excès de cette industrie ?

Pour ce qui a trait à la politique monétaire, il y a présentement un débat autour de la question de la prise en compte de l’évolution de la valeur des actifs (comme les actions en Bourse) dans les décisions des banques centrales. Aux États-Unis, la Federal Reserve défend sa politique des taux d’intérêt5, qui a fait l’objet de critiques selon lesquelles la spéculation boursière et l’impact de la sévère correction auraient pu être en partie évités par une hausse préventive du coût du capital6. Cette question a aussi fait l’objet de réflexions au Canada au moment où les valeurs boursières étaient en hausse rapide7. La théorie de Hayek suggère que le trop faible coût du capital a conduit à un surinvestissement. Mais, tout au long de la période d’expansion, grâce à des gains de productivité, il n’y a pas eu de poussée inflationniste, de sorte que la Federal Reserve, en particulier, s’estimait justifiée de maintenir les taux à un niveau constant. Le débat se poursuit, et il n’y pas de consensus sur cette question.

Également importante est la question de la régulation des marchés financiers et de la gouvernance des entreprises. Des analystes financiers, des courtiers, des banquiers et certains hauts dirigeants d’entreprise qui n’ont pas respecté les règles d’éthique, ou qui se sont livrés à des actions carrément frauduleuses, ont contribué à alimenter la bulle spéculative. Nous examinerons certains aspects de ces questions en lien avec le secteur des télécommunications. Mais il y a ici également tout un débat de fond qui vise à déterminer si des règles plus strictes ou une application plus rigoureuse des règles existantes auraient aussi pu éviter, ou à tout le moins limiter, l’ampleur de la spéculation boursière. C’est une question qui est présentement débattue8 et qui a donné lieu à un renforcement des règles régissant les marchés financiers. Si nous ne discutons pas, dans cette étude, de la question de règles de gouvernance à proprement parler ni de régie des organisations, nous ferons cependant référence au manque d’éthique de certains acteurs du secteur des télécommunications et aux conséquences que cela a eues sur cette industrie.

Par ailleurs, les lois sur les faillites sont une autre dimension de la gestion du cadre juridique dans lequel évoluent les entreprises, et qui ont un effet important sur le comportement présent et futur de l’industrie des télécommunications en Amérique du Nord. Nous verrons que, dans une industrie où il existe un fort excédent de capacité, le recours aux dispositions de la loi qui permettent à une entreprise de se restructurer et de réduire ses dettes par entente avec ses créanciers peut représenter une menace pour des concurrents qui, eux, ont honoré leurs engagements envers leurs créanciers et actionnaires.

Enfin, nous nous demanderons aussi si certaines dispositions de la régulation dans l’industrie des télécommunications n’auraient pas permis de réduire l’ampleur de la bulle spéculative. La mise en place de balises par les organismes de régulation au moment de l’ouverture de la concurrence dans les services de télécommunications et du décloisonnement des secteurs du transport de l’information aurait-elle contribué à atténuer la croissance chaotique de l’industrie ? Notamment, le fait de partager les réseaux tout en préservant la concurrence aurait-il pu, au Canada ou aux États-Unis, contribuer à une meilleure allocation des ressources comme nous l’avons proposé précédemment9 ? On peut aussi se demander si l’approche adoptée par le CRTC à l’ouverture de la concurrence a été l’un des facteurs qui ont contribué à éviter à l’industrie canadienne des télécommunications une débâcle aussi substantielle que celle qui a été observée aux États-Unis.

Vagues schumpétériennes : la croissance chaotique des télécommunications

Le contexte : les nouveaux paradigmes et les prévisions

Avec la révolution numérique et l’arrivée d’Internet, des gourous comme G. Gilder, N. Negroponte et, au Canada, D. Tapscott10 ont annoncé le début de la révolution de la bande passante. Selon eux, les échanges électroniques d’information transformeraient la vie des citoyens et leurs façons de communiquer et de transiger avec les entreprises et les gouvernements, de même que la façon dont se fait l’échange des biens et services dans l’économie. Les quelques entreprises Internet qui avaient fait leur apparition sur le marché traceraient la voie de l’avenir pour tout ce qui touche les nouvelles façons de faire dans l’économie. Toutes ces entreprises qui gravitent autour de l’échange électronique d’information, depuis les équipementiers jusqu’aux aux sociétés d’informatique et de télécommunications, formaient maintenant la « nouvelle économie ». Certains gourous et les analystes financiers ont fait la promotion des « nouveaux paradigmes de gestion » de la « nouvelle économie » visant à éclairer les décisions des gestionnaires d’entreprises et des investisseurs dans ce nouveau contexte.

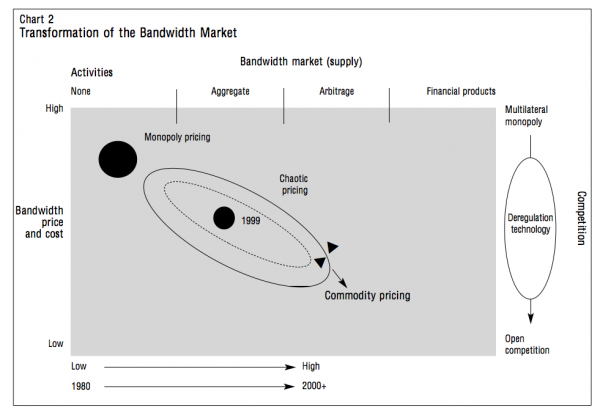

Le fondement de ces nouveaux paradigmes reposait sur une demande illimitée, dans l’avenir, de bande passante. Toutes les transformations de l’économie associées à Internet devaient générer une demande sans cesse croissante de transport de l’information à l’échelle mondiale. G. Gilder, en particulier, s’est fait l’apôtre de cette prophétie au moyen de sa « Newsletter » destinée aux présidents de société et aux investisseurs, ainsi que dans son livre11 Telecosm, présenté comme la bible du nouvel âge des communications. Si l’on considère que certains ont cru cette prévision fondée, alors on peut comprendre un peu mieux ces prétendus nouveaux paradigmes :

D’autres concepts de gestion ont aussi fait leur apparition, notamment celui de « temps Internet ». On prévoyait que l’utilisation des échanges électroniques allait modifier en profondeur et très rapidement les façons de faire, de sorte que les entreprises seraient en mesure de réaliser en trois mois ce qui, avant l’utilisation d’Internet, prenait un an. Selon les gestionnaires des télécommunications, la conception de produits et leur acceptation par les clients allaient donc prendre une fraction du temps traditionnellement prévu pour réaliser ces opérations de mise en marché.

De plus, les entreprises Internet, avec Amazon et Yahoo ! en tête, allaient remplacer les firmes de la « vieille économie » et permettre de faire des transactions de façon moins coûteuse et beaucoup plus rapide. Il en résulterait en accéléré une croissance de la productivité et des niveaux de vie. On anticipait ainsi une croissance énorme des transactions électroniques aussi bien entre les consommateurs et les entreprises (B2C) qu’entre les entreprises elles-mêmes (B2B). Les firmes de sondage et de consultants se sont mises à réviser chaque mois leurs estimations de l’importance du commerce électronique : on a alors prédit que celui-ci se chiffrerait en billions de dollars américains en 200412.

À ces prophéties, il faut ajouter la falsification des données sur le trafic Internet et sur les résultats financiers des entreprises. De novembre 1993 (au moment du lancement du navigateur Mosaic) jusqu’à la cession du réseau au secteur privé, la National Science Foundation (NSF) a constaté que, au lieu de doubler tous les ans, le trafic double tous les trois mois. Puis, la NSF a cédé au secteur privé la gestion d’Internet en avril 1995, et des analystes ont fait des extrapolations à partir de ces données. Mais il était clair que l’on ne pouvait pas maintenir ce rythme. L’industrie avait parié que le trafic Internet doublerait tous les trois mois ; dans les faits, depuis 1997, il a doublé tous les ans. Ce taux de croissance mythique a alimenté les prévisions de toutes les formes de trafic en télécommunications13.

Dans ce contexte, WorldCom-MCI, qui détenait UUnet, le plus gros fournisseur de service Internet en Amérique, a reconnu avoir falsifié14 ses données sur la progression de son trafic Internet aux fins de maintenir la valeur de son action en Bourse. Le gonflement des données du trafic Internet a contribué à entretenir la bulle spéculative dans le secteur des télécommunications. Enfin, des analystes financiers ont embelli les résultats de certaines entreprises pour stimuler les transactions en Bourse, alors que d’autres ont fait des recommandations d’achats d’actions de société dont ils savaient qu’elles faisaient face à des difficultés financières majeures15. À cet égard, plusieurs sociétés de courtage ont accepté de payer des amendes substantielles pour régler hors cours les poursuites engagées par les autorités américaines. Tout cela traduit le climat dans lequel évoluait le monde des télécommunications au moment du boom Internet.

Enfin, les vagues d’innovation — surtout si elles sont supportées par les marchés financiers — s’accompagnent souvent d’une vague entrepreneuriale. La formation des entreprises Internet, les nouveaux venus en télécommunications, la mise au point de nombreux nouveaux services démontraient la vitalité entrepreneuriale générée par cette vague d’innovation. Des cadres de sociétés de téléphonie traditionnelle ont fondé de nouvelles sociétés de télécommunications. Des ingénieurs ou des informaticiens ont aussi quitté des firmes bien établies pour fonder leur propre entreprise. L’attrait de la rémunération en actions au moment où les marchés battaient des records a alimenté cette vague entrepreneuriale. Des sociétés de capital de risque ont appuyé cette création d’entreprises technologiques en fournissant expertise et liquidités financières.

L’expansion des télécommunications

Les investissements

Dans ce contexte, les nouveaux venus dans le secteur et, par effet de concurrence, les ex-titulaires de monopole ont créé des réseaux de fibres optiques qui d’une année à l’autre se voulaient plus innovateurs, plus étendus que ceux de leurs compétiteurs et d’une capacité accrue. Dans une course à l’innovation incrémentielle, les équipementiers mettaient sur le marché des fibres dont la capacité augmentait sans cesse. La technologie du multiplexage optique de Nortel a permis d’acheminer sur une fibre plusieurs longueurs d’onde, ce qui a porté la capacité des réseaux à des niveaux très élevés. Les transporteurs voyaient leurs dépenses en capital croître à des rythmes fulgurants (34 p. 100, à taux annuel composé, de 1996 à 2000) dans divers domaines (réseaux optiques, routeurs, sans-fil, etc.)16. Autre indicateur de cette poussée des investissements, les dépenses en capital, qui représentent de façon tendancielle 15 p. 100 du PIB américain. À la fin des années 1990 et au début des années 2000, cette proportion, en atteignant 33 p. 100, a fait la démonstration de cette vague schumpétérienne d’innovation17.

En fait, vers la fin de la vague d’innovation, c’està-dire vers 1999, les entreprises de télécommunications, en dépit de tous les réseaux déployés, ont commencé à redouter les goulots d’étranglement et les pénuries d’équipement. On se trouvait alors véritablement au sommet de tout le mouvement spéculatif. Les grands équipementiers comme Nortel ou Cisco n’arrivaient pas à satisfaire la demande et devaient pratiquer une forme de rationnement face à leurs clients ; ces derniers se sont donc mis à gonfler artificiellement leur demande d’équipements pour être certains d’obtenir ce dont ils croyaient avoir besoin pour répondre aux besoins du marché.

D’autre part, les nouveaux venus dans le domaine des télécommunications, qui avaient peu de revenus et qui avaient investi dans leur réseau les sommes obtenues sur les marchés financiers, ont commencé à se retrouver en situation de manque de liquidités. Des équipementiers comme Nortel ont alors financé de façon agressive les achats d’équipements de ces clients. Enfin, dans cette course à l’innovation, des firmes comme Nortel et Cisco, au cœur de la révolution Internet, ont fait plusieurs acquisitions d’entreprises technologiques qui, selon leurs estimations, pourraient offrir des produits prometteurs dans le domaine. Ces acquisitions se sont faites au moment où toutes les valeurs des firmes reliées à Internet étaient largement surévaluées.

Les stratégies de croissance

Les sociétés de téléphonie qui étaient déjà en place (souvent des ex-titulaires de monopole) ont fait face à un environnement complexe. Dans un premier temps, l’ouverture de la concurrence sur le marché de l’interurbain les a amenées à affronter des nouveaux venus qui investissaient dans des équipements, ainsi que des revendeurs. Ainsi, aux États-Unis, AT&T devait faire face à des concurrents comme MCI, Sprint ou encore WorldCom ; au Canada, Bell et Telus affrontaient CallNet et Unitel (passée aux mains de AT&T Canada), ainsi que de nombreux revendeurs. Puis, grâce à l’emballement des marchés financiers, sont apparus ceux que l’on a appelés les « Barons de la bande passante ». On pense ici à Qwest, Global Crossing, Level 3 et GTS aux États-Unis, ou encore à 360Network au Canada. Sans héritage du passé, ces nouveaux venus sur le marché ont d’emblée adopté les nouvelles technologies pour se construire des réseaux. De plus, les ex-titulaires de monopole ont dû ouvrir leur réseau aux fournisseurs de services Internet (FSI). Parmi ces entreprises, celles qui faisaient affaire sur la boucle locale ont donc eu l’obligation (que n’avaient pas les nouveaux venus) de fournir le service local, et ont dû aussi ouvrir cette dernière partie du réseau à d’éventuels compétiteurs quand la concurrence a été permise sur ce marché.

Dans ce contexte d’innovation et face à cette concurrence, les sociétés traditionnelles ont déployé diverses stratégies. Elles ont investi dans leur propre réseau pour le moderniser et augmenter sa capacité. Mais elles ont aussi adopté une stratégie de sautemouton en faisant l’acquisition de fournisseurs de services. La stratégie de guichet unique (analysée plus loin) a aussi été retenue par des sociétés comme Bell au Canada ou AT&T aux États-Unis. Ces sociétés ont procédé à des acquisitions pour être présentes dans plusieurs catégories de services.

WorldCom, née de la fusion de diverses compagnies de télécommunications, a aussi adopté la stratégie du guichet unique par intégration verticale et horizontale. Les acquisitions de UUnet et de MCI ont fait de WorldCom le plus gros fournisseur de services Internet en Amérique du Nord et un acteur majeur du marché de l’interurbain ; une tentative d’acquisition de Sprint, qui visait à combler la lacune de la société dans la téléphonie sans fil, a cependant été refusée par les autorités américaines responsables de la concurrence. Nous discuterons plus loin de ces stratégies de croissance par acquisitions.

Cette vague de transformations s’est également accompagnée d’un autre changement majeur sur le marché des télécommunications. Les ex-titulaires de monopole, qui étaient jusque-là très actifs en recherche et développement — souvent à travers une filiale (comme Nortel, pour Bell) ou des laboratoires (comme Bell’s Labs, pour AT&T) —, ont pratiquement abandonné la R et D, alors que les équipementiers, tels que Nortel, Lucent et Cisco, ont connu une croissance fulgurante alimentée par les progrès technologiques et le milieu financier18. Dans le cas de Bell, au Canada, le délestage de Nortel a été une stratégie qui a permis à l’entreprise d’améliorer sa position de trésorerie tout en créant des gains pour les actionnaires. Les ex-titulaires de monopole, devenus ainsi des opérateurs de réseau et des fournisseurs de services, n’avaient pratiquement plus de contrôle sur le rythme de développement de l’innovation. Il faut voir ici qu’en abandonnant la fonction de R et D, les compagnies de télécommunications ont réduit les barrières à l’entrée dans leur industrie, puisque tous les nouveaux venus avaient accès auprès des équipementiers à la plus récente technologie19. Elles ont donc contribué en quelque sorte à accentuer la concurrence dans leur secteur.

En plus de faire des acquisitions, les sociétés de téléphonie ont aussi conclu des alliances avec d’autres sociétés, surtout à l’étranger. AT&T a établi un partenariat avec British Telecom. Sprint faisait partie de Global One, une alliance d’envergure qui comprenait France Telecom et Deutsche Telekom et dont le but était d’offrir des services complets de télécommunications de bout en bout aux grandes multinationales.

Les nouveaux venus associés aux « Barons de la bande passante » ont d’abord compté sur le déploiement de réseaux de fibres optiques à grand débit pour aller chercher des fonds sur les marchés financiers. Mais ils ont aussi déployé des efforts pour développer une clientèle et apporter du trafic sur leur réseau. Dans ce domaine, QWest a été une entreprise modèle durant quelques années et un phare pour les investisseurs. Cette société a conclu plusieurs ententes de partenariat avec diverses entreprises et fait quelques acquisitions stratégiques aux ÉtatsUnis et ailleurs dans le monde, notamment en Europe. Puis, avec la vague de fusions et de consolidations qui prenait de l’intensité à la fin des années 1990, Qwest, en concurrence avec Global Crossing, a réussi à faire l’acquisition de la société de téléphonie locale USWest.

Cette fusion se fondait sur un modèle d’affaires prometteur alliant nouvelle technologie et réseau traditionnel, culture entrepreneuriale et culture de monopoleur, un modèle qui, arrimé aux services aux clients, devait apporter une source de revenu stable. Cependant, en raison de sa capitalisation surévaluée par la vague spéculative, QWest a contracté des emprunts pour faire ces acquisitions, et a donc par la suite fait face à un coût de service de la dette important.

Global Crossing, qui, avec la canadienne 360Network, constituait selon Gilder le modèle d’avenir des sociétés de télécommunications, a aussi emprunté une voie semblable à celle de Qwest en faisant l’acquisition de Frontier, une petite compagnie de téléphonie locale.

Les grands monopoles nationaux en Europe, ainsi que NTT au Japon, ont essayé de se transformer en opérateurs globaux offrant un guichet unique à leurs clients, en faisant des acquisitions, en construisant de nouveaux réseaux et en prenant part aux actions des opérateurs étrangers20. Les compagnies européennes ont aussi misé sur le fait que l’augmentation de la demande dans le domaine des communications fixes serait suivie par une même augmentation en communications mobiles. Ainsi, plus de 100 milliards d’euros (l’équivalent du PIB de l’Irlande) ont été dépensés pour financer l’acquisition de licences des réseaux mobiles 3G.

L’éclatement de la bulle spéculative

Les signes avant-coureurs

C’est en 2000 que les premiers signaux annonçant la fin de la bulle spéculative ont commencé à apparaître, avec l’effondrement des entreprises Internet. Ces firmes, qui devaient éclipser les sociétés de la « vieille économie », ont fait face à une crise de liquidités, et plusieurs ont déclaré faillite. Des prévisions irréalistes concernant les transactions en ligne, une surestimation des revenus publicitaires et de la fréquentation des sites Web, un mauvais choix de modèles d’affaires et une grave sous-estimation de problèmes réels comme l’approvisionnement et la livraison des biens aux clients sont les principaux facteurs qui ont conduit au retentissant échec des firmes Internet21. Ce point tournant a été une première indication très claire qu’il n’y avait aucune commune mesure entre les prévisions de croissance du commerce électronique et la réalité.

Les avertissements de Nortel à l’automne de 2000 à propos de ses ventes et de ses profits ont été le point de départ de la dégringolade de la valeur de son titre. Puis a suivi le krach des marchés financiers (actions et dettes) de 2001, qui a lourdement touché l’industrie des télécommunications.

Le retour à la réalité

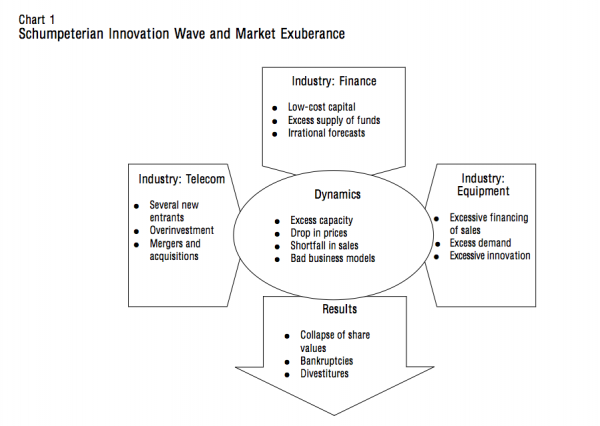

En peu de temps, tous les agents de l’industrie des télécommunications et du secteur financier ont pris conscience de l’important déséquilibre qui s’était creusé entre la demande et l’offre de bande passante, d’une part, et les services qui y sont associés, d’autre part22. Le problème ne provenait pas du fait que chaque firme prise individuellement installait trop de fibres, mais plutôt du fait que plusieurs firmes étaient en train simultanément de construire des réseaux quasiment identiques. Aux États-Unis, plus d’une douzaine de réseaux dorsaux à l’échelle nationale ont été construits. Un scénario assez similaire s’est reproduit en Europe de l’Ouest23. Le côté sombre des vagues d’innovation à la Schumpeter est illustré à la page suivante à l’aide du graphique 1, qui résume la dynamique réelle et financière du mouvement qui a déferlé sur l’industrie des télécommunications.

Les conséquences du surinvestissement dans les télécommunications

À partir du graphique 1, on constate que l’excès considérable d’offre de bande passante a engendré plusieurs conséquences dans le secteur des télécommunications et sur les marchés financiers.

Aujourd’hui, les transporteurs font désormais face à un nouvel environnement qui les force à retarder le déploiement des technologies de nouvelles générations, à réduire leurs coûts et à tirer plus de valeur de leur réseau existant. Cela force les équipementiers à revoir leur stratégie de conception de produits et de mise en marché. Ils doivent, par exemple, offrir des équipements qui permettent de faire le pont entre les réseaux traditionnels des transporteurs avec les nouvelles technologies.

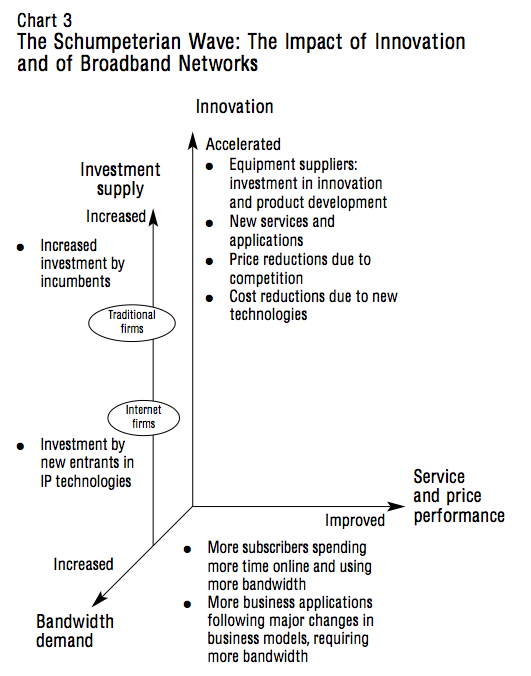

Les aspects positifs de la vague d’innovation

Les actionnaires et les créanciers des entreprises de télécommunications ont subi les contrecoups de la débâcle du secteur. La mauvaise allocation des ressources qui a accompagné le boom Internet a entraîné des pertes importantes pour l’économie, puisque les investissements auraient pu être utilisés de façon plus rentable. Toutefois, la vague d’innovation a eu des effets positifs pour les demandeurs des nouveaux services mis en marché. Elle a aussi contribué à relever les gains de productivité dans l’économie30 et à abaisser les coûts des produits et services vendus sur les marchés. Les consommateurs qui ont profité des baisses de prix et les travailleurs qui ont pu obtenir des gains de salaires sans créer de tensions inflationnistes sont les gagnants de ce boom technologique31. Le graphique 3 illustre les effets positifs de la vague schumpétérienne d’innovation.

Les utilisateurs des services de télécommunications ont bénéficié de plusieurs nouveaux services et d’une baisse importante du prix de la bande passante. Les accès Internet, par exemple, considérés comme des produits à valeur ajoutée au milieu des années 1990, sont rapidement devenus, sous l’effet de la concurrence et de la diffusion de la technologie Internet, des services peu coûteux et facilement accessibles pour les ménages et pour les entreprises. Un abonné à Internet peut communiquer avec un interlocuteur branché de n’importe quelle région du globe sans avoir à encourir de frais d’interurbain. La construction d’un site Web, auparavant considérée comme un service réservé aux grandes entreprises, est maintenant à la portée des petites entreprises et des particuliers.

L’un des effets majeurs de la révolution Internet est la transformation des modèles d’affaires dans l’ensemble de l’économie. Les échanges électroniques de données entre les entreprises au moyen de réseaux privés existaient déjà depuis un certain temps et avaient commencé à transformer les modèles d’affaires32 des grandes entreprises multinationales. Les firmes Internet ont contribué à faire connaître le commerce électronique aux divers agents économiques. De nouvelles firmes ont construit d’emblée des modèles d’affaires rentables fondés sur les échanges électroniques d’information.

Le cas du fabricant d’ordinateur Dell demeure le modèle de référence. L’entreprise traite avec ses clients de partout dans le monde à partir de son site Internet et transmet électroniquement à son réseau de soustraitants les commandes de pièces nécessaires pour répondre aux besoins de la clientèle. Le produit est livré au client et le service après-vente est en bonne partie fait à partir de son site Internet. De plus, Dell accumule sur ses clients diverses informations qui lui permettent de bien connaître leurs besoins et de concevoir en fonction de ces besoins les générations prochaines de produits. Ce modèle permet d’atteindre un haut niveau de productivité, de minimiser les coûts de transaction et d’interaction avec les intervenants tout au long de la chaîne de valeurs ajoutées et d’assurer à la clientèle un service personnalisé.

Les entreprises de toute taille de la « vieille économie » se sont appropriées, à des degrés divers et de différentes façons, ce modèle d’affaires rendu accessible grâce à la technologie Internet et à son réseau public. Cela s’est traduit notamment par des gains de productivité, des baisses de prix de divers biens et services, une accélération de la mise en marché de nouveaux produits plus performants, et une amélioration de la relation entre les clients et les vendeurs. Il s’agit de gains importants pour l’ensemble des agents économiques.

Cette transformation de l’économie est d’ailleurs loin d’être terminée. Sous le jeu de la concurrence et de la disponibilité grandissante de la technologie Internet, notamment dans sa version sans fil, la révolution numérique qui se fait grâce aux réseaux de télécommunications va continuer à moyen terme de transformer les façons de faire dans l’économie, y compris dans le secteur public (incluant, le cas échéant, la santé et l’éducation), et être ainsi une source d’amélioration des niveaux de vie. Les innovations majeures empruntent des parcours difficiles à prévoir et s’échelonnent sur des décennies avant d’avoir leur plein effet. Une erreur majeure des analystes de la révolution numérique a été de croire que les façons de faire dans l’économie et la société en général allaient se transformer rapidement et sans interruption.

Enfin, les prétendus nouveaux paradigmes de gestion ont disparu des analyses financières, et l’on assiste à un juste retour aux critères habituels de rentabilité pour juger des investissements. La distinction entre « vieille » et « nouvelle » économie, à l’origine d’erreurs de prévisions, de décisions d’investissement et de choix de modèle d’affaires33, a pratiquement disparu du vocabulaire des analystes.

Modèles d’affaires : l’approche du « guichet unique » ou de la « convergence »

En plus des excès d’investissement dans les capacités de transport, le choix des modèles d’affaires a aussi contribué à la transformation et aux difficultés du secteur des télécommunications. Parmi les nombreuses fusions qui ont été réalisées dans l’industrie des télécommunications, plusieurs n’ont pas donné les résultats escomptés. Des sociétés doivent aujourd’hui démanteler les conglomérats édifiés pendant le boom Internet, puisque les stratégies, qui reposaient sur des modèles d’affaires fondés sur l’intégration verticale et l’intégration horizontale, se sont avérés des échecs dans plusieurs cas.

Le choix des modèles d’affaires

La stratégie du guichet unique, en régime de concurrence, a pour but d’établir une présence sinon dominante ou à tout le moins incontournable sur le marché. Une telle stratégie est inspirée à la fois de la culture de monopole des entreprises de télécommunications traditionnelles, habituées à offrir tous les services sur le marché, et de la stratégie du regroupement des services (« bundling ») comme technique de marketing visant à maximiser le nombre de clients sur un réseau de transport d’information. Les ex-titulaires de monopole ayant une base de clientèle encore importante, des moyens financiers appréciables et un portefeuille substantiel d’actifs ont vu là une excellente stratégie pour répondre à la concurrence croissante.

À l’opposé de cette approche dont l’objectif est de détenir tous les actifs qui définissent la compétence d’une entreprise, il y a celle du courtier ou de la syndication. Cette stratégie consiste à offrir tous les services aux clients en ne détenant aucune infrastructure ou en ne possédant que certains actifs clés (comme un réseau de téléphonie), et en faisant appel à plusieurs fournisseurs de services qui détiennent des actifs de télécommunications. Un courtier doit avoir une connaissance en profondeur du domaine des télécommunications pour bien répondre aux besoins des clients et être en mesure de gérer tout un réseau de fournisseurs de services. Face à la fragmentation et à la spécialisation du marché de l’informatique, c’est le modèle qu’a récemment appliqué IBM en créant son service de consultation « Global Services », où des spécialistes établissent les meilleures solutions pour les clients, solutions qui comportent des produits qui viennent de fournisseurs autres qu’IBM. La compagnie n’a pas à exceller dans tous les créneaux du marché et met en valeur sa vaste connaissance de l’informatique. IBM s’est mise à l’écoute de ses clients sur un marché où elle a perdu le quasi-monopole qu’elle détenait autrefois.

Les sociétés traditionnelles de téléphonie ont plutôt été habituées historiquement à fonctionner dans un univers où elles contrôlaient les infrastructures supportant les services offerts34. Lorsque le marché connaît une expansion de capacité et de services offerts, une telle stratégie implique plusieurs acquisitions d’actifs. AT&T et WorldCom, aux États-Unis, et BCE, au Canada, avaient adopté cette stratégie. Du côté des nouveaux venus, la stratégie d’acquisition a été perçue comme un moyen d’acquérir rapidement des clients de façon à accroître l’utilisation des réseaux mis en place. Qwest et AOL sont allées dans cette direction.

La stratégie d’intégration

La stratégie dite de convergence n’est autre chose que la stratégie conventionnelle de l’intégration verticale35. À la fin des périodes d’expansion, lorsque les sociétés ont des liquidités, on assiste souvent à un important courant d’acquisitions dont l’objectif est la création d’une intégration verticale ou encore horizontale d’entreprises. L’intégration verticale comme stratégie d’affaires n’a pas eu historiquement beaucoup de succès36. Récemment, une étude37 réalisée à l’échelle mondiale a montré que, sur la période 19901997, peu de fusions ont permis d’atteindre les objectifs poursuivis. Les résultats indiquent que seulement 12 p. 100 des entreprises fusionnées ont réussi à améliorer la croissance de leur chiffre d’affaires. Les entreprises fusionnées dans les secteurs de haute technologie n’obtiennent pas de meilleurs résultats.

L’un des facteurs qui expliquent ces résultats est le fait que ce ne sont pas les coûts et les supposées économies d’échelle et d’envergure ou de réseau qui déterminent le succès d’une fusion, mais bien plutôt la croissance des revenus de l’entité fusionnée. La non-réalisation des promesses des gestionnaires en termes de progression des revenus fait baisser le cours de l’action de la nouvelle société. Les mesures que prennent alors les dirigeants pour réduire les coûts ont pour effet de handicaper la nouvelle entreprise et de l’empêcher de croître. Les problèmes de fusion de différentes cultures d’entreprise rendent, dans ce contexte, les choses encore plus difficiles. On observe alors des ventes d’actifs et un démantèlement au moins partiel du conglomérat. Les actionnaires font ainsi souvent les frais des promesses non réalisées faites par les gestionnaires au moment de l’acquisition.

L’intégration ou la syndication : analyse du cas de BCE

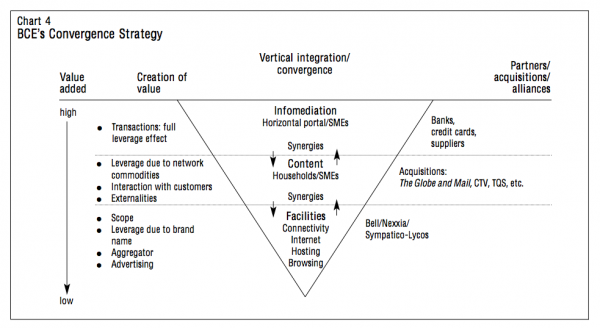

Vue d’ensemble : La stratégie de BCE a été inspirée à la fois du modèle du guichet unique détenteur des actifs de transport et aussi de celui de la « convergence » entre la capacité de transport, l’informatique et le contenu. On retrouvera à l’annexe 1 les principaux éléments de cette stratégie, qui comporte la création de nouvelles filiales, l’acquisition d’entreprises et des alliances avec des partenaires.

« Connectivité, commerce et contenu » étaient les termes retenus pour décrire la stratégie derrière le conglomérat construit par les dirigeants de BCE. On misait sur les synergies entre les différents actifs de l’ensemble de façon à ce que la rentabilité du conglomérat surpasse la somme des profits des unités. Par exemple, à travers le portail Sympatico de Bell Actimedia, on comptait amener les clients à s’abonner au Globe and Mail et à regarder diverses émissions de la chaîne CTV. Avec ce conglomérat, Bell devenait « incontournable » sur le marché des communications. Le résultat de la stratégie de BCE concorde avec les résultats de l’étude McKinsey sur les fusions que nous avons citée plus haut. Les synergies obtenues entre les unités du conglomérat n’ont pas été à la hauteur des attentes. Comme cela a été le cas de façon générale dans cette industrie, le pouvoir d’attraction du portail ainsi que les résultats des efforts de marketing croisé entre les produits offerts sur Internet ont été inférieurs aux prévisions. De plus, l’achat à fort prix de Téléglobe a été une mauvaise acquisition. Les investisseurs ont sanctionné sévèrement la stratégie de BCE.

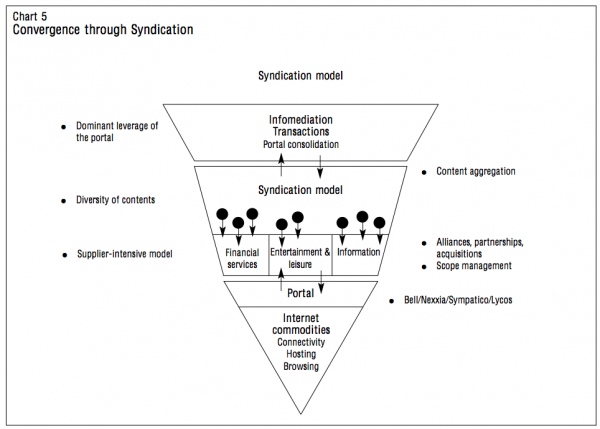

Convergence : acquisition ou syndication : Le cas de BCE nous permet d’illustrer la stratégie de convergence à l’aide du graphique 4, qui s’applique aux entreprises de communications qui ont adopté la stratégie dite de « convergence » de transport et de contenu. Puis, à l’aide du graphique 5, nous montrerons que BCE aurait pu obtenir les résultats recherchés en utilisant le modèle de syndication qui implique peu ou pas d’acquisitions.

La stratégie de convergence vise à permettre à une entreprise qui vend des services de communications de gravir un échelon de valeurs ajoutées de façon à obtenir un rendement plus élevé sur ses actifs. Dans ce modèle, la combinaison de la connectivité et du contenu vise à attirer une clientèle de plus en plus importante et à amener celleci à faire de multiples transactions électroniques : l’entreprise devient en quelque sorte un cyber-courtier capable d’offrir une vaste sélection de biens et services dont cette clientèle a besoin38.

Au graphique 4, on retrouve, dans la partie inférieure du triangle, la situation de BCE avant ses principales acquisitions. La société possédait un réseau (doté entre autres d’une capacité de transport de données à haute vitesse, Nexia) et offrait des services Internet aux entreprises et aux ménages grâce à Sympatico-Lycos. L’entreprise voulait offrir des produits à plus haute valeur ajoutée, car, sous l’effet de la concurrence, l’accès Internet et les autres produits (comme les engins de recherche ou l’hébergement de données) étaient devenus des services offrant de faibles marges bénéficiaires. C’est pourquoi on a adopté une stratégie qui visait à permettre de se déplacer vers le haut du triangle, où l’on retrouve des activités à plus haute valeur ajoutée. Il s’agissait d’activités d’infomédiation, qui devaient permettre à BCE, avec d’autres partenaires (comme des banques, pour l’aspect financier, et divers fournisseurs de biens et services), de devenir un super-courtier offrant aux clients un vaste choix de transactions. Pour atteindre cet objectif, il fallait offrir du contenu qui attirerait une clientèle plus nombreuse et prête à payer pour y avoir accès. Une clientèle plus importante devait aussi attirer davantage les annonceurs. Plus le portail est connu et agrège le trafic, plus il attire de clients en réduisant les coûts de transaction et de recherche, et plus il tend à s’imposer sur le marché. C’est un effet de réseau semblable à celui qu’a utilisé Windows, de Microsoft, une entreprise qui a réussi ainsi à s’imposer sur le marché. C’est aussi ce que l’on entendait par « effet de levier de la marque de commerce », Bell dans ce cas-ci. C’était au cœur de la stratégie de convergence.

Mais l’effet d’attraction du contenu ne s’est pas manifesté avec l’ampleur prévue, et la fonction d’infomédiaire s’est plutôt fragmentée sur le Web ; ce sont des sites spécialisés comme E-Bay ou Amazon qui ont eu d’avantage de succès en matière de transactions. Il est encore possible que le rôle d’infomédiaire général se développe sur le Web, mais il faudra attendre des générations futures d’internautes pour que cette fonction devienne rentable.

BCE s’est donc retrouvée avec des actifs dont elle n’a pas réussi à tirer la valeur qu’elle prévoyait au moment où elle a réalisé de coûteuses acquisitions. C’est ce qui explique la décision récente de la nouvelle direction de mettre ces actifs en vente. Tous les coûts reliés aux transactions et aux pertes sur la valeur des actifs auraient pu être évités, au moins en partie, si l’entreprise avait adopté la stratégie de syndication illustrée au graphique 5.

La stratégie de syndication ne consiste pas à acheter des entreprises de contenu, mais plutôt à conclure des alliances ou des partenariats avec divers fournisseurs de contenu sans avoir à investir dans les entreprises partenaires, sauf possiblement dans le cas de certaines firmes dont on estimerait que les produits sont essentiels au succès de la stratégie. Avant de conclure des ententes, on peut mettre les fournisseurs en concurrence les uns avec les autres de façon à obtenir les meilleurs rapports qualité/prix. On réussit, de cette manière, à aller chercher une vaste gamme de contenus en fonction des besoins prévus de la clientèle. Il est toujours possible d’ajouter de nouveaux fournisseurs ou de mettre un terme à certaines ententes en fonction de l’évolution des besoins du marché. Le maître d’œuvre doit être capable d’observer efficacement l’évolution du marché, ainsi que de négocier avec plusieurs fournisseurs et de gérer plusieurs ententes à la fois. Cela implique donc certains coûts de complexité qu’il faut pouvoir assumer, mais cette stratégie est beaucoup plus souple et financièrement moins contraignante que celle de l’intégration verticale39.

Cette stratégie est bien connue dans le monde de l’information ; une entreprise de distribution d’information — un journal, par exemple — doit s’approvisionner à plusieurs sources pour obtenir l’information. Elle peut détenir certains fournisseurs jugés essentiels, mais procédera plutôt, en général, par ententes avec plusieurs sous-traitants. Dans le cas des firmes Internet, le courtier en ligne E-Trade, par exemple, a adopté la stratégie de la syndication en ayant recours à plusieurs fournisseurs d’informations et d’analyses financières. E-Bay, une entreprise Internet rentable, a d’une part plusieurs fournisseurs d’accès en amont, et d’autre part plusieurs autres en aval qui se chargent de livrer et d’assurer les biens échangés sur son site, ainsi que de sécuriser les paiements et, le cas échéant, de faire le recouvrement des créances. E-Bay a récemment acquis Paypal, une entreprise qu’elle a jugée essentielle à la bonne conduite de ses affaires. Autrement, elle fonctionne grâce à des ententes avec plusieurs sous-traitants et partenaires. BCE aurait donc pu utiliser cette stratégie, et il est probable que, de cette façon, la valeur des actions aurait été mieux protégée40. Les difficultés de BCE ne viennent pas seulement de l’excédent de capacité que connaît l’industrie et de la baisse des prix de services comme l’interurbain, mais aussi de son choix de stratégie de croissance.

Cette analyse vaut aussi pour AOL/Time Warner ou encore pour Vivendi, qui ont été les principaux adeptes de la stratégie de convergence. Dans le cas de AOL, non seulement les synérgies souhaitées ne se sont pas matérialisées, mais il y a également eu un problème bien documenté de cohabitation de cultures d’entreprise ; c’est un type de problème que peut entraîner une fusion et dont même la seule perception peut devenir cruciale. Les frictions entre les deux organisations de départ ont aussi contribué à l’échec de la transaction.41 Enfin, au Québec, l’acquisition de Vidéotron par Quebecor est une intégration à rebours, le détenteur de contenu acquérant le transporteur. Quebecor et la Caisse de dépôt et placement auraient sans doute pu éviter en grande partie la radiation d’actifs s’ils avaient mis le contenu de Quebecor en valeur en négociant simplement sa présence sur divers portails. Quebecor n’avait pas, du point de vue de la promotion du contenu, à détenir d’infrastructures de transport pour y arriver; bien sûr, d’autres objectifs ont pu motiver cette acquisition.

Conclusions

En plus de la croissance excessive de la capacité de transport alimentée par les « prophètes » de la bande passante, de mauvais choix de modèles d’affaires sont venus amplifier la débâcle du secteur des télécommunications. Comme bien d’autres gestionnaires l’ont fait dans le passé en période d’expansion économique et à la faveur de marchés financiers très favorables, les dirigeants de l’industrie ont cru que les acquisitions seraient une voie prometteuse pour assurer la croissance des bénéfices à plus long terme. Ces dirigeants ont maintenant l’allure d’apprentis sorciers, alors que leurs successeurs doivent souvent, pour éviter le pire, démanteler les empires édifiés par leurs prédécesseurs. Ce sont les actionnaires et les créanciers des sociétés de téléphonie qui ont fait les frais de cette aventure du guichet unique et de la convergence.

La vague schumpétérienne des télécommunications au Canada

L’ampleur du phénomène

L’ampleur de la vague d’innovation au Canada n’a pas été comparable à celle que l’on a pu observer aux États-Unis. D’abord, au sortir de la récession, le Canada était aux prises avec un déficit budgétaire considérable, et le fardeau de la dette publique pesait lourdement sur l’économie canadienne. Les hausses d’impôt destinées à réduire le déficit freinaient de façon sensible la croissance de la consommation, et les besoins d’emprunts des gouvernements créaient des tensions sur les marchés financiers. Aussi, de 1992 à 1998, la croissance moyenne du PIB au Canada (2,9 p. 100) était sensiblement inférieure à celle des États-Unis, qui se situait autour de 3,5 p. 100. Avec la disparition des déficits et la réduction du poids de la dette, le Canada a vu sa croissance s’accélérer à partir de 1998-1999, alors que la bulle spéculative touchait à sa fin. Le Canada a évité la récession qui a sévi aux États-Unis et qui résultait en bonne partie de l’éclatement de la bulle spéculative décrite plus haut. La chute des entreprises Internet, les faillites spectaculaires d’entreprises de la « nouvelle économie », Enron en tête, et la débâcle du secteur des télécommunications ont entraîné l’économie américaine dans la récession de 2001.

Le Canada n’a pas connu un retournement aussi spectaculaire dans le secteur des télécommunications. Quelques entreprises comme AT&T Canada, 360Network et Téléglobe, filiale de Bell, ont eu recours à la loi sur les faillites, alors que Nortel a subi une restructuration majeure. Cela a certes contribué au ralentissement de l’économie qui s’est produit en 2001, mais sans avoir l’effet qu’a eu l’écroulement des entreprises Internet et de grandes sociétés comme WorldCom sur l’économie américaine.

Ouverture de la concurrence et évolution du marché

Dans le secteur des télécommunications, l’approche du CRTC face à l’ouverture de la concurrence n’a pas conduit, comme cela a été le cas aux États-Unis pour AT&T en 1984, à un démantèlement des plus grosses sociétés canadiennes comme Bell et Telus. Si le Canada avait suivi le modèle américain, BellLocal serait devenue une entreprise indépendante de BellInterurbain. Les ex-titulaires de monopole ont plutôt gardé la partie de leurs opérations reliée aux appels locaux, et ont ainsi conservé leur emprise sur le dernier kilomètre que les signaux doivent parcourir pour atteindre les clients. L’ouverture de la concurrence s’est faite d’abord dans le domaine des appels interurbains, et les membres de Stentor — organisme qui regroupait toutes les entreprises de télécommunications en situation de monopole — ont dû ouvrir leur réseau aux nouveaux venus sur ce marché. Puis, le décloisonnement de la téléphonie et de la câblodistribution (la décision historique 94-19 du CRTC) a permis la concurrence entre ces deux secteurs de transport de l’information. Maintenant, les entreprises de câblodistribution offrent des services d’accès Internet et de transport de données et peuvent offrir des services de téléphonie, alors que les compagnies de téléphone peuvent offrir des services de télédiffusion.

Enfin, l’ouverture de la concurrence sur le marché des services locaux et interurbains s’est faite suivant un processus complexe et s’est accompagnée de règles multiples. Les ex-titulaires de monopole ont dû ventiler leurs coûts et leurs actifs de façon à pouvoir établir des tarifs d’accès à leur réseau. Le rééquilibrage des tarifs sur le marché du service local a permis de réduire l’interfinancement en faveur du marché résidentiel, mais sans l’éliminer complètement. Les concurrents des anciens membres de Stentor ont alors dû, en plus de payer des frais d’accès au réseau, contribuer à l’interfinancement relié au marché du service local résidentiel. Élément plus complexe encore, les nouveaux venus sur la boucle locale ont droit à une subvention transférable (« portable subsidy »), payée à même les contributions, pour compenser l’écart entre les coûts et les tarifs sur ce marché. En somme, le CRTC a considéré que son mandat l’autorise à faire de la redistribution de revenus sur le marché de la téléphonie. Tout cela complexifie le fonctionnement du marché de la téléphonie, et est à l’origine de tensions continuelles entre les nouveaux venus et les ex-titulaires de monopole.

L’approche du CRTC, dite du « retrait du régulateur » (« forbearance ») lorsque la concurrence est suffisante, a permis de créer un environnement concurrentiel sur le marché de l’interurbain au Canada42. En fait, plusieurs entreprises se sont présentées sur le marché de l’interurbain43 ; mais il s’est surtout agi de revendeurs, et un nombre limité de nouveaux venus ont déployé de véritables réseaux sur le territoire. Sauf dans quelques cas, comme celui de Fonorola, ce sont surtout des sociétés ayant des affiliations américaines (par exemple Sprint et AT&T, qui a fait l’acquisition d’Unitel) qui ont investi dans les infrastructures.

Compte tenu de la petite taille du marché canadien et de l’importance qu’y occupent des sociétés comme Bell et Telus, il n’y a pas eu au Canada une vague de nouveaux venus comparable à celle qui s’est produite aux États-Unis, où des entreprises naissantes ont quadrillé le territoire de fibres optiques ; seule 360 Network peut être classée parmi les « Barons de la bande passante ». Enfin, avec l’arrivée d’Internet, plusieurs FSI ont fait leur apparition au Canada et certains, comme I-Star, ont eu des succès éphémères sur le marché financier. Les grandes sociétés de téléphonie et de câblodistribution ont contribué à la consolidation du marché. Il n’y a pas, sur le marché canadien, de FSI comparable à AOL et qui aurait exercé un effet important d’agrégation de trafic et représenté une menace sérieuse pour les télécommunicateurs et les câblodistributeurs.

Le décloisonnement de la téléphonie et de la câblodistribution au moment de la décision historique 94-19 n’a cependant pas eu tous les effets escomptés. Les entreprises de câblodistribution offrent des services d’accès Internet et de transport de données, mais, contrairement aux prévisions, elles n’ont pas envahi le marché de la téléphonie.

La concurrence sur le marché de l’interurbain a été suffisamment importante pour faire en sorte que le CRTC se retire et laisse le marché déterminer les prix. Les ex-membres de Stentor ont perdu des parts significatives de marché dans un contexte de baisse importante des tarifs. En 1999, environ 25 p. 100 des ventes sur le marché de l’interurbain appartenaient aux concurrents des ex-titulaires de monopole44. La baisse des prix a eu un effet négatif sur la rentabilité des anciens membres de Stentor, et ceux-ci ont dû déployer beaucoup d’efforts pour préserver la valeur de leur capitalisation. La stratégie de BCE analysée plus haut et la baisse des prix sur le marché de la téléphonie ont pénalisé les actionnaires de la société. Toutefois, la présence des exmembres de Stentor sur le marché du service local et l’absence quasi totale de concurrence sur ce segment du marché (voir plus loin) ont assuré à ces entreprises un flux de revenus qui a permis de stabiliser leur situation financière. En comparaison, aux États-Unis, les concurrents présents sur le marché de l’interurbain n’ont pas eu cette source stable de revenus et ont donc été encore plus durement touchés par la guerre des prix.

Mais les nouveaux venus sur le marché de l’interurbain ont éprouvé beaucoup de difficulté à atteindre la rentabilité. Le cas de AT&T Canada illustre bien ce phénomène. Grâce à l’intervention du gouvernement fédéral, AT&T Canada a d’abord repris Unitel, qui avait déjà perdu près d’un demi-milliard de dollars ; on a permis à la société américaine de détenir 49 p. 100 de la compagnie canadienne. Mais, ne réussissant pas à être vraiment rentable, AT&T Canada s’est départie du secteur résidentiel (repris par Primus) pour se concentrer sur le lucratif secteur des affaires. Puis, en octobre 2002, l’entreprise a déclaré faillite, et la société-mère américaine a décidé de se retirer de cette filiale. Aujourd’hui, AT&T, allégée du fardeau de sa dette, est devenue Allstream ; on ne peut encore affirmer si elle réussira ou non à être rentable45. Ces nouveaux venus sur le marché de l’interurbain ont toujours soutenu que les frais d’accès au réseau consentis par le CRTC aux ex-monopoleurs étaient trop élevés pour que de nouvelles entreprises puissent être rentables. Nous reviendrons plus loin sur cette épineuse question de la rentabilité des concurrents de Telus et de Bell et des frais d’accès au réseau.

Comme cela a été le cas aux États-Unis, les utilisateurs canadiens — aussi bien les ménages que les entreprises — sont les grands gagnants de l’ouverture de la concurrence et du boom de la technologie. Grâce au jeu de la concurrence, ils ont bénéficié d’une baisse des prix de l’interurbain et des accès Internet. Ils ont aussi profité de nombreux nouveaux services offerts sur le marché. Et grâce entre autres au réseau de câblodistribution, les Canadiens bénéficient maintenant d’une offre concurrentielle en matière d’accès Internet à haute vitesse.

L’évolution de l’industrie des télécommunications

L’industrie au sortir de la correction de marché

L’industrie doit maintenant composer avec les conditions qui découlent des excès spéculatifs des dernières années, et satisfaire les besoins d’une clientèle dont les objectifs sont arrimés à la réalité économique. Du coté de la demande, l’ensemble de l’économie continue à se numériser, mais à un rythme réaliste et sous des contraintes de coûts et de rentabilité. Le commerce électronique va continuer de progresser, mais pour atteindre des niveaux bien inférieurs à ceux que certains prévoyaient il y a quelques années. Du côté de l’offre, on estime que l’industrie fonctionne à environ 40 p. 100 de sa capacité46 et qu’il faudra attendre jusqu’en 2006 avant que l’excédent se résorbe.

De plus, une menace, liée à la loi sur les faillites, pèse sur l’industrie. Lorsque des sociétés utilisent cette loi pour se protéger de leurs créanciers, leur capacité de transport ne disparaît pas pour autant. Si elles réussissent à s’entendre avec leurs créanciers, elles reviennent alors sur le marché avec une dette allégée, tandis que leurs concurrents qui n’ont pas fait faillite doivent continuer à assumer les coûts de service de leur dette. Au Canada par exemple, 360Networks, AT&T Canada et Téléglobe ont conclu de telles ententes avec leurs créanciers. Des investisseurs peuvent aussi racheter les sociétés en faillite à un prix bien inférieur aux coûts encourus pour mettre en place des réseaux de transport à haute capacité. Déjà, on a assisté à quelques achats de transporteurs à des prix qui ne représentaient qu’une fraction de la valeur passée de ces entreprises47.

On voit ici l’asymétrie concurrentielle qui risque d’émerger sur le marché des télécommunications. Les entreprises acquises à bon marché ou celles qui se sont allégées du fardeau de leur dette pourront, pour augmenter la clientèle sur leur réseau, déclencher une autre guerre des prix qui risque d’être fatale aux compagnies qui ont réussi à survivre aux conditions difficiles du marché. Des sociétés américaines endettées comme Verizon, QWest ou encore AT&T pourraient à leur tour devoir se réfugier derrière la loi sur les faillites. On pourrait alors parler d’effet « domino », une situation que prédisent certains analystes48, et qui confirmerait la tendance dangereuse à la baisse des prix associée à l’excédent de capacité, dévastatrice pour les investisseurs du secteur des télécommunications. Le processus de destruction de richesse dû aux excès passés pourrait donc se poursuivre pendant un certain temps avant que l’industrie ne réussisse à se stabiliser.

La poursuite de la consolidation

Compte tenu de l’excédent d’offre, ainsi que de l’économique des réseaux — qui exige que l’on amortisse les frais fixes des infrastructures sur le plus grand nombre possible de clients —, le mouvement de consolidation qui s’est amorcé avec la faillite de plusieurs transporteurs devrait se poursuivre pendant une certaine période. Les ex-titulaires de monopole de la boucle locale aux États-Unis (les RBOC), en particulier, se retrouvent actuellement dans une situation financière généralement meilleure que les autres transporteurs et pourraient faire l’acquisition à des prix très avantageux de sociétés d’interurbain qui viennent de se sortir de la faillite ou qui luttent pour l’éviter. Dans leur résistance à ouvrir le marché local à la concurrence (que nous analyserons plus loin), ces sociétés ont déjà procédé à une vaste consolidation de ce segment du marché des télécommunications, grâce à plusieurs acquisitions. SBCCommunications, par exemple, est devenue de cette façon un nouveau géant des télécoms.

Récemment, certains États ont forcé les RBOC à baisser leurs tarifs de gros sur la boucle locale de façon à stimuler la concurrence. AT&T a profité de ces décisions pour assurer une présence sur le marché du service local dans huit États, et WorldCom, maintenant sous le chapitre 13 de la loi américaine sur les faillites, offre des services locaux dans 33 États49. Si cette concurrence continue de prendre de l’ampleur, il pourrait être possible que l’on autorise les RBOC qui ont le droit d’être présentes sur le marché de l’interurbain à acquérir un transporteur50. Le marché américain se rapprocherait alors du marché canadien, puisque des sociétés pourraient être présentes à la fois sur le marché de l’interurbain et sur la boucle locale. Si, à titre d’exemple, un géant comme SBCCommunications, ou encore Verizon51, faisait l’acquisition à un prix avantageux d’un autre géant en faillite comme WorldCom, la nouvelle entreprise serait en position de mieux exploiter les économies de réseau et d’assurer un flux plus stable de revenus. Une telle consolidation nous amènerait vers un marché des télécommunications à caractère plutôt oligopolistique.

Au Canada, on a aussi assisté à la consolidation du marché, que l’on peut par exemple observer avec ce que sont devenus des ex-membres de Stentor. BCTel et AGT, dans l’Ouest canadien, se sont regroupées pour former Telus, qui a par la suite procédé à des acquisitions sur le marché canadien, notamment en achetant QuébecTel, au Québec, et Clearnet, en Ontario, dans le domaine du sans fil, avec l’objectif de concurrencer Bell sur l’ensemble du territoire canadien. On a vu que Bell a conclu diverses alliances impliquant des participations financières pour étendre sa présence sur le marché canadien. Sprint Canada a fait l’acquisition du transporteur Fonorola, spécialisé dans les services aux entreprises, et AT&T Canada a acheté MetroNet, un fournisseur de téléphonie locale pour les entreprises dans les grands centres urbains. Telus, nous l’avons dit, s’est portée acquéreur de QuébecTel, alors que Bell a conclu divers accords avec des transporteurs comme Aliant, dans l’Est du pays, et Manitoba Tel, dans l’Ouest, en plus de détenir Télébec au Québec.

La consolidation du marché peut aussi se faire à travers de nouveaux venus qui disposent des liquidités et de l’expertise nécessaires pour offrir des services spécialisés. Ainsi, Integrated Device Technology (IDT), un intégrateur de systèmes, a acquis le transporteur en faillite Winstar pour une fraction de sa valeur aux livres (42 millions de dollars), et pourrait faire d’autres acquisitions à bon marché de sociétés en faillite ou en difficulté.

Les modèles d’affaires en émergence

Après la convergence et le guichet unique, les modèles d’affaires qui devraient s’imposer sont ceux qui exigent une plus grande spécialisation des entreprises. Les tendances récentes de consolidation permettent de prévoir que trois modèles d’affaires seront très présents dans les années à venir. Le premier est celui des sociétés de téléphonie qui, s’étant recentrées sur leur mission traditionnelle, deviendraient dans un monde compétitif des transporteurs très efficaces aux coûts d’exploitation très bas, d’une grande fiabilité et offrant des platesformes capables d’intégrer les diverses technologies sur le marché. On peut penser que le recentrage en cours de Bell Canada va dans cette direction.

Le deuxième modèle d’affaires correspond aux entreprises qui occuperaient un créneau spécialisé du marché, comme les services à large bande, notamment pour les échanges de données complexes entre les entreprises ou d’autres organisations à l’échelle internationale. En consolidant des réseaux à large bande et en utilisant son expertise informatique, une entreprise comme IDT pourrait se diriger vers ce modèle. Au Canada, AT&T, devenue Allstream après sa faillite, a cédé sa clientèle résidentielle à Primus et se spécialise maintenant dans les services aux entreprises.

Enfin, le troisième modèle — nous l’avons décrit plus haut — est celui du courtier qui offre, en partenariat avec d’autres sociétés, un assemblage de solutions à ses clients. C’est le cas, par exemple, des sociétés de téléphonie qui délaissent le rôle de transporteur pour se concentrer sur une offre de services à valeur ajoutée. La nouvelle direction de AT&T, aux États-Unis, semble aller dans cette voie. AT&T s’est départie de plusieurs actifs liés au modèle de guichet unique et désire se retirer du secteur résidentiel pour se consacrer aux services aux entreprises. La société a d’ailleurs conclu en décembre 2002 une entente avec IBM et Intel pour créer une coentreprise, Cometa Networks, qui offre les services d’un réseau intégré d’accès Internet sans fil (Wi-Fi) aux entreprises dans les aéroports, les édifices à bureaux et d’autres lieux publics. AT&T a donc assemblé avec des partenaires une offre de services à valeur ajoutée pour les entreprises qui doivent maintenir un contact Web continu avec leurs cadres en déplacement.

Dans quelques années, l’industrie des télécommunications aura changé de profil et redeviendra, après les « années folles » du boom Internet, une industrie mieux ancrée dans la réalité du marché et bien arrimée sur des critères de rentabilité.

Les politiques de régulation et la vague schumpétérienne

L’ouverture de la concurrence sur les marchés de la téléphonie a été un élément important de la vague d’innovation des années 1990. Si les sociétés de téléphonie avaient conservé leur monopole, elles auraient contrôlé le rythme d’introduction des nouvelles technologies. Afin de récupérer les coûts historiques de leur réseau, elles auraient eu intérêt à ralentir la modernisation de leurs équipements. Ce faisant, les équipementiers auraient été moins pressés de mettre en marché des produits de plus en plus performants grâce à toute une série d’innovations incrémentielles. De plus, si le système de réglementation qui déterminait les tarifs des services sur la base de leur coût plus un rendement juste et équitable avait été maintenu, les prix n’auraient pas suivi la tendance à la baisse en accéléré que l’on a enregistrée au cours de la dernière décennie. La pénétration de la technologie Internet dans l’ensemble de l’économie aurait été nettement plus limitée que celle que l’on observe maintenant. À cet égard, d’ailleurs, l’hésitation de certains pays européens à permettre la concurrence sur leur marché des télécommunications a retardé la numérisation de leur économie et donc réduit leur capacité concurrentielle52. La concurrence a donc été un facteur déterminant pour l’éclosion du boom technologique.

Toutefois, dans le secteur de l’interurbain, le régime concurrentiel et l’économique des réseaux n’ont pas produit des résultats optimaux, c’est-à-dire des résultats où, idéalement, l’intérêt des clients et celui des actionnaires des sociétés de téléphonie convergent. D’autre part, sur la boucle locale, la concurrence s’est révélée complexe et n’a pas produit les résultats escomptés.

L’héritage du passé et l’ouverture de la concurrence

L’ouverture de la concurrence sur le marché de l’interurbain et sur la boucle locale suppose que les organismes de régulation établissent pour les concurrents qui s’amènent sur le marché les tarifs d’accès aux réseaux des exmonopoleurs : c’est l’un des problèmes majeurs que pose l’ouverture de la concurrence. En pleine vague d’innovation, la détermination de ces tarifs est encore plus complexe, puisque la nouvelle technologie de transport d’information en protocole IP est nettement moins coûteuse que celle des réseaux hérités du passé.

En principe, les coûts d’accès à ces réseaux devraient refléter les prix que l’on pratiquerait en situation concurrentielle. Or, si un organisme de régulation permet à un ex-titulaire de monopole de réclamer ses coûts historiques, les nouveaux venus ne paient pas à la marge uniquement pour le service rendu, mais défraient aussi une partie des amortissements de tous les investissements qui ont déjà été réalisés par le monopoleur. Dans un marché concurrentiel, les amortissements historiques sont non pertinents puisque ce sont les conditions courantes de l’offre et de la demande qui déterminent les prix. Aux États-Unis, la réponse de la FCC à ce problème en 1996 au moment de l’ouverture de la concurrence sur le marché local a été d’utiliser l’approche des coûts de la technologie la plus récente53 pour déterminer les tarifs d’accès sans faire référence aux coûts historiques des monopoleurs. Cette approche a soulevé un tollé de la part des RBOC, qui se sont lancées dans une querelle juridique, qu’elles ont en partie gagnée54. L’un des arguments des ex-monopoleurs consistait à souligner qu’ils avaient investi en toute bonne foi dans le passé et que leurs actionnaires ne devaient pas faire les frais de l’ouverture de la concurrence55. C’est donc une question complexe qui illustre une autre dimension de l’économique des réseaux56. On ne peut mettre rapidement au rancart un réseau dans lequel un transporteur a investi des sommes appréciables sans pénaliser les actionnaires qui ont investi avec les informations du moment dans la société de téléphonie qui a bâti ce réseau.

Au Canada, sur cette question, le CRTC a tenté de prendre une voie intermédiaire en permettant aux extitulaires de monopole de récupérer une bonne partie de leurs coûts historiques et en utilisant également les coûts incrémentiels à long terme pour établir les tarifs d’accès. On peut comprendre les tensions qui existent sur le marché à propos de ces tarifs, puisque les nouveaux venus estiment payer pour des coûts historiques dont ils ne retirent aucun bénéfice. À cette difficile question s’ajoute le fait que le CRTC ne favorise pas un fonctionnement efficace du marché des télécommunications lorsqu’il continue à faire de la redistribution de revenus en maintenant cet héritage de l’interfinancement en faveur des abonnés résidentiels. Le rééquilibrage des tarifs aurait dû permettre l’élimination de l’interfinancement, et le CRTC aurait dû laisser au gouvernement fédéral le soin de régler cette question. Si le gouvernement estime que la téléphonie doit être abordable pour tous les citoyens, il y aurait alors lieu d’accorder un crédit d’impôt (comme on le fait pour la TPS) aux contribuables à faible revenu pour couvrir les frais reliés à l’augmentation des tarifs de téléphonie. De cette façon, les nouveaux venus n’auraient pas à contribuer à un fonds destiné à interfinancer le marché local. Cela ferait au moins disparaître l’une des sources de tension sur le marché des télécommunications.

En fait, des sociétés comme CallNet Entreprises et AT&T Canada ont toujours prétendu que les tarifs d’accès au réseau de Telus et de Bell étaient trop élevés pour leur permettre d’être rentables. AT&T Canada a d’ailleurs contesté la dernière décision du CRTC qui a plafonné les tarifs résidentiels jusqu’en 2006 et réduit les frais d’accès au réseau de 15 p. 100 en mai 2002. Cette réduction était bien inférieure à celle que demandait AT&T Canada, mais le cabinet des ministres qui a entendu l’appel a maintenu la décision du CRTC57. De plus, le CRTC a estimé d’une part que la concurrence sur le marché de l’interurbain était en baisse et d’autre part que Bell, Aliant, Telus, MTS et Saska Tel n’avaient pas respecté certaines de ses décisions concernant l’accès des concurrents à leur réseau. Enfin, il y a également des affrontements entre les câblodistributeurs et les sociétés de téléphonie, notamment en ce qui a trait à l’offre de services de télévision.

Après 10 ans de concurrence dans le secteur des télécommunications, on doit constater qu’il existe encore beaucoup de tensions entre les divers intervenants sur le marché canadien et qu’il est très difficile pour les nouveaux venus d’être rentables. La concurrence a eu plusieurs effets bénéfiques pour les utilisateurs, mais les actionnaires ont subi les contrecoups de la concurrence. Aux États-Unis, avant le boom Internet, des concurrents importants de l’ex-monopoleur AT&T58, comme MCI ou Sprint, ont atteint la rentabilité sur le marché de l’interurbain. Au Canada, la petite taille du marché, compte tenu de l’économique des réseaux, peut expliquer en partie ce résultat. De plus, le fait d’être présents sur la boucle locale et le marché de l’interurbain peut conférer aux ex-monopoleurs des avantages sur le plan de la détermination des tarifs et des stratégies commerciales. Le CRTC a d’ailleurs établi diverses règles pour éviter que les ex-monopoleurs utilisent des pratiques de prix d’éviction face à leurs concurrents. Cependant, les ex-membres de Stentor ont une marge de manœuvre en matière de groupement (« bundling ») des offres que n’ont pas nécessairement les nouveaux venus. Les affrontements sur le marché de la télévision portent justement sur l’interfinancement que Bell serait en mesure de faire entre ses services groupés offerts sur le marché.

En conclusion, on peut donc se demander si la façon dont s’est faite la concurrence dans les télécommunications sur un marché de la taille de celui du Canada permet la présence d’un certain nombre de concurrents rentables à moyen terme. L’expérience canadienne n’est pas concluante à ce stade-ci et soulève diverses questions que nous examinerons en termes plus généraux à la dernière section. On ne doit pas souhaiter que les télécommunications comme secteur innovateur et absolument essentiel au bon fonctionnement et à la compétitivité de l’économie empruntent une voie semblable à celle du transport aérien, où il est devenu très difficile d’être rentable et où l’on voit des géants recourir à tour de rôle à la loi sur les faillites pour assurer leur survie à moyen terme. Ce modèle conduit à un assèchement de l’offre de fonds qui est essentielle pour financer les investissements qui sont le véhicule du progrès technologique. Cela est encore plus vrai dans le contexte actuel des contraintes sur l’investissement étranger. En revanche, comme nous l’avons indiqué plus haut, la concurrence a été un facteur essentiel de la vague d’innovation de la dernière décennie. Pour le marché canadien, la formule qui permettrait de faire converger l’intérêt des utilisateurs et des actionnaires resterait à déterminer.